Le RIA : Comment être conforme avec l’IA

Le 12 juillet 2024 marque un tournant dans la régulation de l’intelligence artificielle au sein de l’Union Européenne, avec l’adoption du Règlement Européen sur l’Intelligence Artificielle (RIA). Ce texte ambitieux, publié au Journal officiel de l’Union européenne (JOUE), établit un cadre légal inédit pour encadrer le développement, la mise sur le marché, et l’utilisation des systèmes d’IA, tout en complétant le Règlement Général sur la Protection des Données (RGPD).

Il vise à assurer une intelligence artificielle respectueuse des droits des individus et à sécuriser les entreprises innovantes.

Qu’est-ce que le Règlement IA ?

Le Règlement Européen sur l’IA (RIA) est la première législation globale au monde visant à encadrer le développement, la mise sur le marché, et l’utilisation des systèmes d’intelligence artificielle. Il cherche à gérer les risques que l’IA peut poser pour la santé, la sécurité, et les droits fondamentaux des individus.

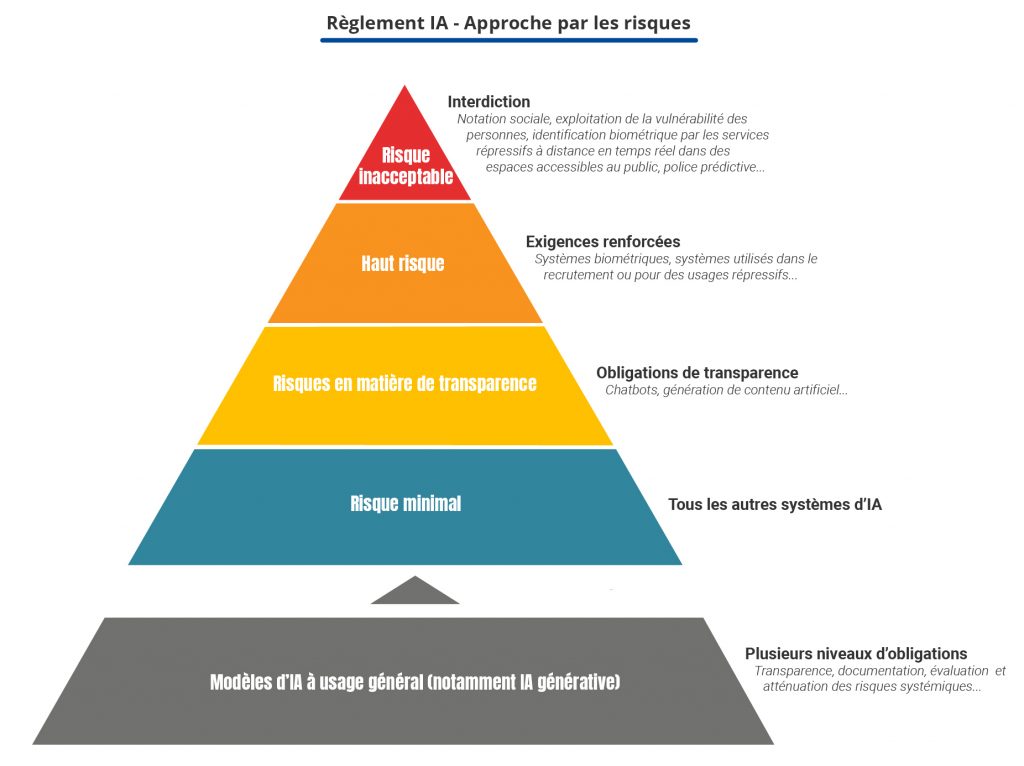

Quatre niveaux de risque

Le RIA adopte une approche fondée sur le risque, classant les systèmes d’IA en quatre niveaux :

- Risque inacceptable : le RIA interdit certaines pratiques contraires aux valeurs de l’Union Européenne et aux droits fondamentaux.

- Exemples : notation sociale, exploitation de la vulnérabilité des personnes, techniques subliminales, identification biométrique à distance par les forces de l’ordre, police prédictive ciblant les individus, reconnaissance des émotions sur le lieu de travail ou dans les écoles.

- Haut risque: ces systèmes peuvent porter atteinte à la sécurité des personnes ou à leurs droits fondamentaux, nécessitant ainsi des exigences renforcées (évaluations de conformité, documentation technique, mécanismes de gestion des risques).

- Exemples : Systèmes biométriques, systèmes de recrutement, applications dans le domaine répressif.

- Risque spécifique en matière de transparence: Les systèmes soumis à des obligations de transparence pour éviter la manipulation.

- Exemples: Utilisation de chatbots, génération de contenu artificiel.

- Risque minimal : aucun obligation spécifique pour ces systèmes, qui constituent la majorité des IA utilisées dans l’UE.

Les modèles d’IA et RGPD à usage général

Le RIA réglemente aussi les modèles d’IA à usage général, tels que ceux utilisés dans l’IA générative. Ces modèles, qui servent à diverses tâches, posent des défis pour leur classification dans les catégories de risque. Le règlement prévoit plusieurs niveaux d’obligations pour ces modèles, allant de la transparence minimale à une évaluation approfondie des risques.

Qui contrôle l’application du RIA ?

Au niveau Européen :

- Comité Européen de l’IA : cet organisme rassemble des représentants de haut niveau de chaque État membre pour assurer une application cohérente du règlement. Il est appuyé par un forum consultatif multi-acteurs et un groupe scientifique d’experts indépendants qui conseillent sur les décisions critiques.

En France

- Autorités compétentes : la France désignera, d’ici 12 mois, une ou plusieurs autorités responsables de la surveillance du marché des IA. L’une de ces entités agira comme point de contact national pour faciliter les échanges avec la Commission Européenne et les autres États membres.

Articulation de l’IA avec le RGPD

Le RIA remplace-t-il le RGPD ?

Non, le RIA ne remplace pas le RGPD mais le complète. Le RGPD s’applique à tous les traitements de données personnelles, tandis que le RIA s’adresse spécifiquement aux systèmes et modèles d’IA.

Exigences spécifiques du RIA

Le RIA impose des exigences spécifiques qui peuvent aider à satisfaire les obligations du RGPD. Par exemple, la conformité au RGPD est incluse dans la déclaration de conformité UE requise par le RIA.

Transparence et documentation

Les deux règlements partagent des notions de transparence et de documentation, mais sous des angles différents. Le RIA exige des informations techniques détaillées et des analyses d’impact sur les droits fondamentaux, complétant les obligations de transparence du RGPD.

Calendrier de mise en application

Le RIA entrera en vigueur le 1er août 2024, avec une application échelonnée :

- 2 février 2025 : interdictions sur les systèmes d’IA à risque inacceptable.

- 2 août 2025 : règles pour les modèles d’IA à usage général et nomination des autorités compétentes.

- 2 août 2026 : toutes les dispositions du RIA deviennent applicables, notamment pour les systèmes d’IA à haut risque.

- 2 août 2027 : application des règles pour les systèmes d’IA à haut risque

Besoin d’un accompagnement sur l’IA ?

- Une équipe experte dans la protection des données et l’IA

- Des analyses d’impact utile pour l’intégration de l’IA dans votre entreprise

- Des formations dédiées

Impact du RIA sur le RGPD – Différences et complémentarités

| RIA | RGPD |

| Couvre le développement, la mise sur le marché, et le déploiement des systèmes d’IA | Couvre tous les traitements de données personnelles |

| S’adresse principalement aux fournisseurs et déployeurs de systèmes d’IA | Cible les responsables de traitement et sous-traitants |

| Approche par les risques | Approche fondée sur des principes et l’évaluation des risques |

| Sanctions jusqu’à 35 millions d’euros ou 7% du chiffre d’affaires | Amendes jusqu’à 20 millions d’euros ou 4% du chiffre d’affaires |

Le RIA et le RGPD se complètent, le premier facilitant la conformité au second. La CNIL continue de jouer un rôle central en veillant à l’application des deux règlements.

La CNIL et l’application du RIA

La Commission Nationale de l’Informatique et des Libertés (CNIL) jouera un rôle clé dans l’application du RIA, en veillant au respect des normes pour les systèmes d’IA traitant des données personnelles. Elle guidera les acteurs afin qu’ils respectent à la fois le RIA et le RGPD, offrant une vision intégrée des règles applicables. La CNIL continuera également de sanctionner les pratiques interdites, telles que la création de bases de données de reconnaissance faciale sans consentement.

Articles similaires